Di Massimo Conte

Premessa: questa puntata di Agopunture digitali è stata presentata all’interno del web meeting AperiCep #2: il ritorno delle tribù del 25 maggio 2021, evento organizzato dal Complexity Education Project per il Festival della Complessità.

In che modo si informano le persone, attraverso la rete e i social Network?

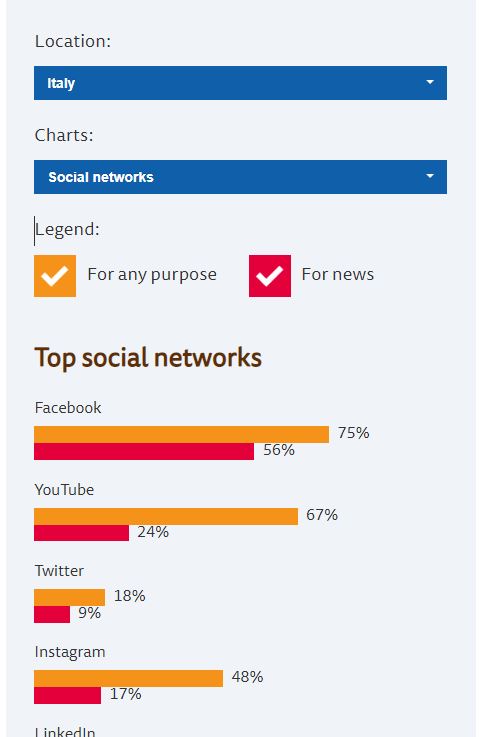

Il Digital News Report2020, elaborato dal Reuters Institute e dall’Università di Oxford è un’indagine sul consumo di informazioni on line, effettuata su un campione di oltre 80mila persone in 40 nazioni.

Ad esempio per l’Italia, tra i tanti dati interessanti, emerge che nel 2020 circa il 56% del campione ha utilizzato Facebook a fini informativi (nella visualizzazione interattiva è possibile vedere anche i dati degli altri social network).

Fonte: Digital News Report

Ma facciamo un passo indietro, per parlare di Filter Bubble attraverso una visualizzazione dati realizzata dal designer cinese Sylvester Lau, che simula un possibile algoritmo che mostra informazioni ad un utente.

Il termine “Filter Bubble” è diventato popolare alcuni anni fa, in seguito alla pubblicazione del libro The “Filter Bubble: What the Internet Is Hiding from You” dall’attivista Eli Pariser.

Come sintetizza wikipedia, nel libro si sostiene che la bolla di filtraggio è il risultato del sistema di personalizzazione dei risultati di ricerche su siti che registrano la storia del comportamento dell’utente. Questi siti sono in grado di utilizzare informazioni sull’utente (come posizione, click precedenti, ricerche passate) per scegliere selettivamente, tra tutte le risposte, quelle che vorrà vedere l’utente stesso. L’effetto potrebbe essere quello di escludere informazioni che sono in contrasto con il suo punto di vista, isolandolo in tal modo nella sua bolla culturale o ideologica.

Questo approccio è stato successivamente contestato da altri studiosi che ritengano che l’effetto non sia così facilmente dimostrabile, ma ai fini di questa rubrica lo descriveremo comunque attraverso una visualizzazione dati interattiva.

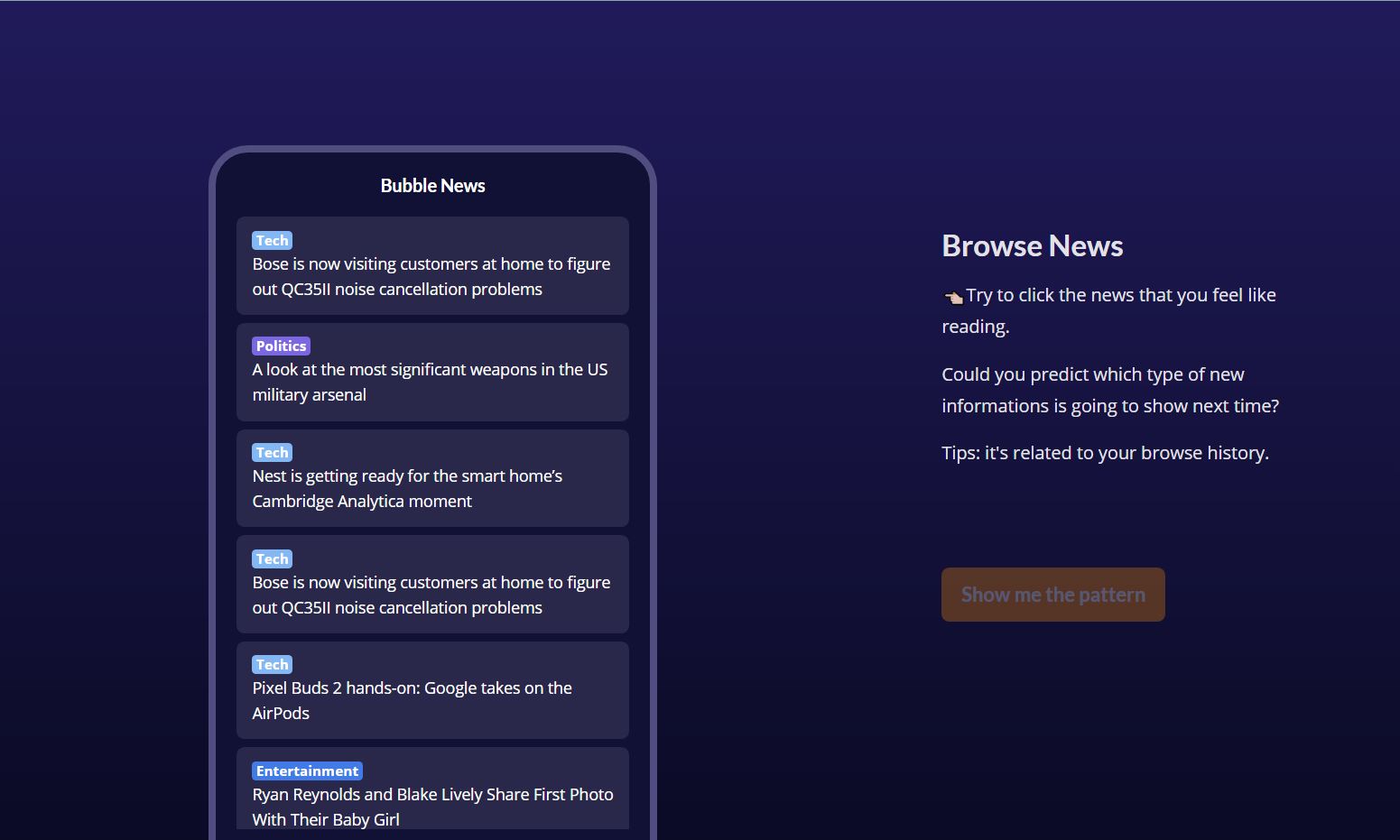

Ogni giorno consumiamo informazioni di diversi tipi. Vediamo ad esempio l’esperienza di un utente in questa app di notizie immaginaria, che chiameremo “Bubble News”.

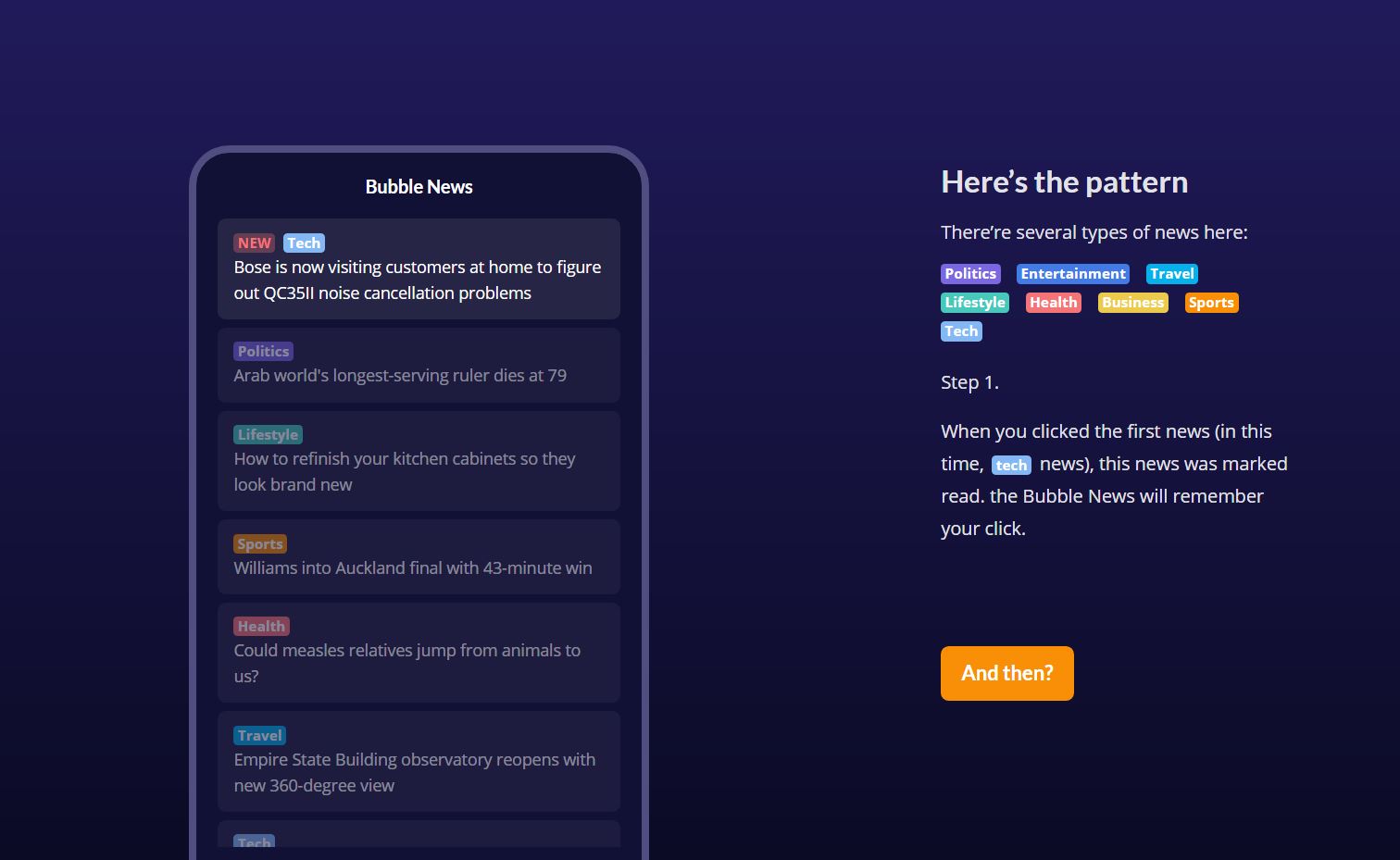

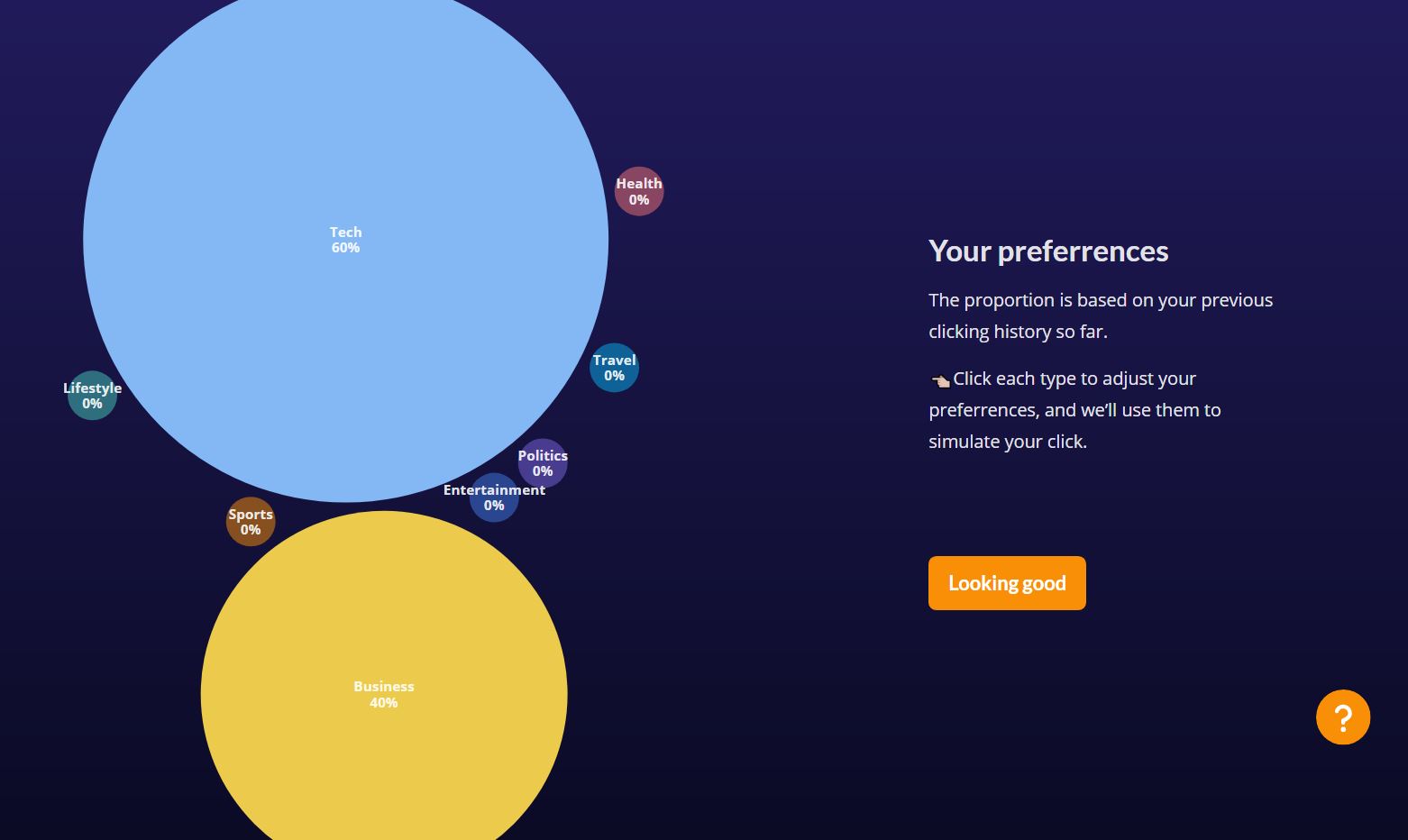

Se le classifichiamo, potremmo distinguere ad esempio tra politica, spettacolo, viaggi, salute, affari, sport, tecnologia, come si vede sulla destra nell’immagine qui sotto.

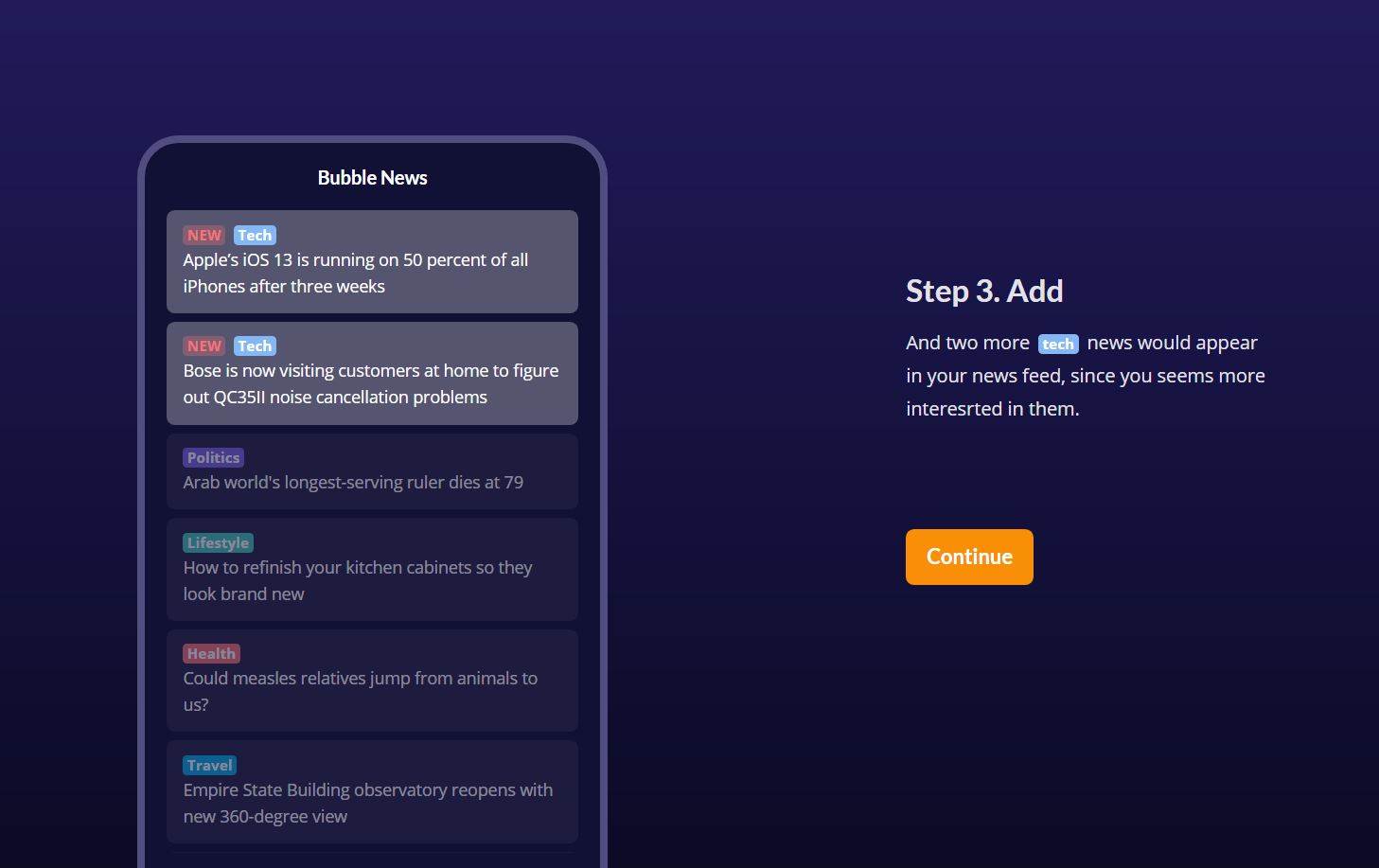

A questo punto vediamo cosa succede se la nostra ipotetica app “Bubble news”, rimuove una notizia di sport e ne aggiunge due tecnologia, che in base ai primi clic fatti nell’app sembra l’argomento preferito dall’utente.

In base a questo algoritmo iper-semplificato, le notizie che vedo saranno influenzate dalle mie scelte.

Possiamo vedere le stesse notizie rappresentate all’interno di una bolla, come puntini. Ogni colore, un tipo di notizia.

Per alimentare l’algoritmo, bisogna scegliere un argomento preferito. Per ogni clic su un pallino-notizia, il pallino viene eliminato (la notizia è stata letta, cioè consumata, e quindi non è più mostrata), ma l’algoritmo alimenta l’app inserendo altre due notizie dello stesso argomento.

Alla fine un report mostra come è caratterizzata la mia bolla, cioè quali sono le notizie prevalenti.

Prova te a giocare con la visualizzazione dati interattiva

In sostanza, la Filter bubble è la personalizzazione delle informazioni a cui siamo esposti, scelte automaticamente in base alla nostra cronologia di navigazione e profilatura.

È importante sottolineare la differenza tra echo chamber e filter bubble.

Si parla di echo chamber quando potrebbe esserci una sovraesposizione a informazioni con cui siamo d’accordo, che potenzialmente possono distorcere la nostra percezione della realtà, sbilanciandola troppo su un punto di vista, senza avere più visibilità di punti di vista differenti. Con il rischio di poter pensare che quello che vediamo corrisponda al mondo intero (e da qui al confirmation bias il passo è breve: cerchiamo solo prove che confermino il nostro pregiudizio e la nostra visione).

Si parla di filter bubble per descrivere la situazione in cui notizie che non ci piacciono o con cui siamo in disaccordo vengono automaticamente filtrate. Sono quindi il risultato di in un filtraggio effettuato dagli algoritmi.

Per riflettere ed aumentare la nostra consapevolezza digitale, ci sono alcuni punti da mettere a fuoco.

- Filter bubble: vedo le informazioni selezionate per me dagli algoritmi;

- Potenziale Distorsione realtà: ai miei Bias si sommano i Bias delle fonti che scelgo?

- Polarizzazione: si creano echo chambers (casse di risonanza) differenti e in contrapposizione.

In chiusura, sebbene sia importante essere vigili su questi aspetti della nostra vita digitale, serve anche ricordare che probabilmente non serve un approccio da apocalittici: gli algoritmi scelgono in base alla nostra profilatura, cioè alle nostre scelte, per creare un ambiente, una bolla, all’interno della quale siamo a nostro agio.

Più siamo esposti a certi contenuti, più è probabile che ne vorremo di più. Se siamo all’interno di un echo chamber, più alcune idee si ripetono e si enfatizzano. Il rischio è che possiamo confondere quella bolla per la realtà.

Come viene suggerito anche nella visualizzazione dati già citata precedentemente, possiamo, sebbene non sia facile, provare ad allentare questo meccanismo: ad esempio provando ad aggiungere rumore (noise) alla nostra bolla, cioè contenuti diversi dal nostro punto di vista, non perfettamente allineati nella nostra nicchia.

Tutto questo per costruire una dieta variegata e creare la nostra personale ecologia dell’informazione.